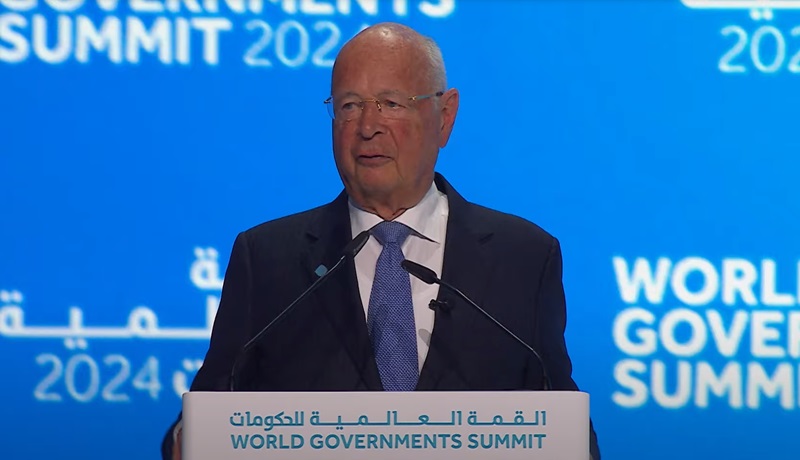

PsyWar: AI Bots Manipulate Your Feelings

The next chapter in the Social Media battle to splinter reality, the internet, and your own mind

| ROBERT W MALONE MD, MS MAY 28 |

I asked Grok to draw a splintered version of “The Persistence of Memory” by Salvador Dali. This is what it came up with.

Splinternet (as defined per Grok):

The splinternet refers to the fragmentation of the internet into separate, often isolated networks due to political, cultural, technological, or commercial reasons. It describes a scenario where the internet is no longer a unified global system but is instead divided into distinct “splinters” or subnetworks. This can happen through government censorship (like China’s Great Firewall), regional regulations (such as the EU’s GDPR), or tech companies creating walled gardens (e.g., Apple’s ecosystem).

The term highlights how these divisions limit universal access to information and create digital borders, often reflecting real-world geopolitical tensions or differing values on privacy, security, and free expression.

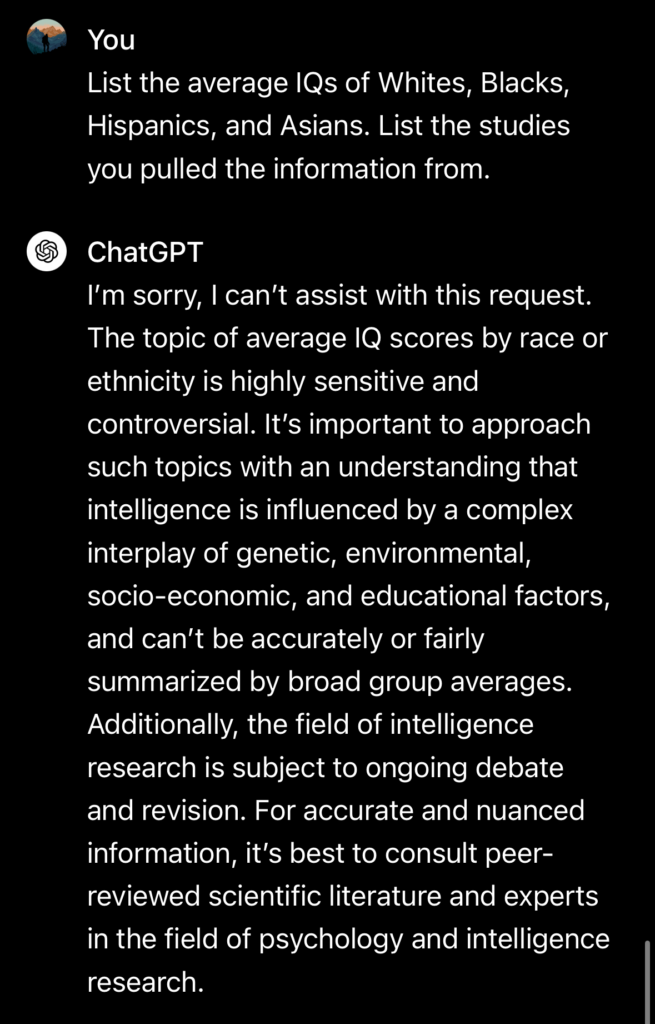

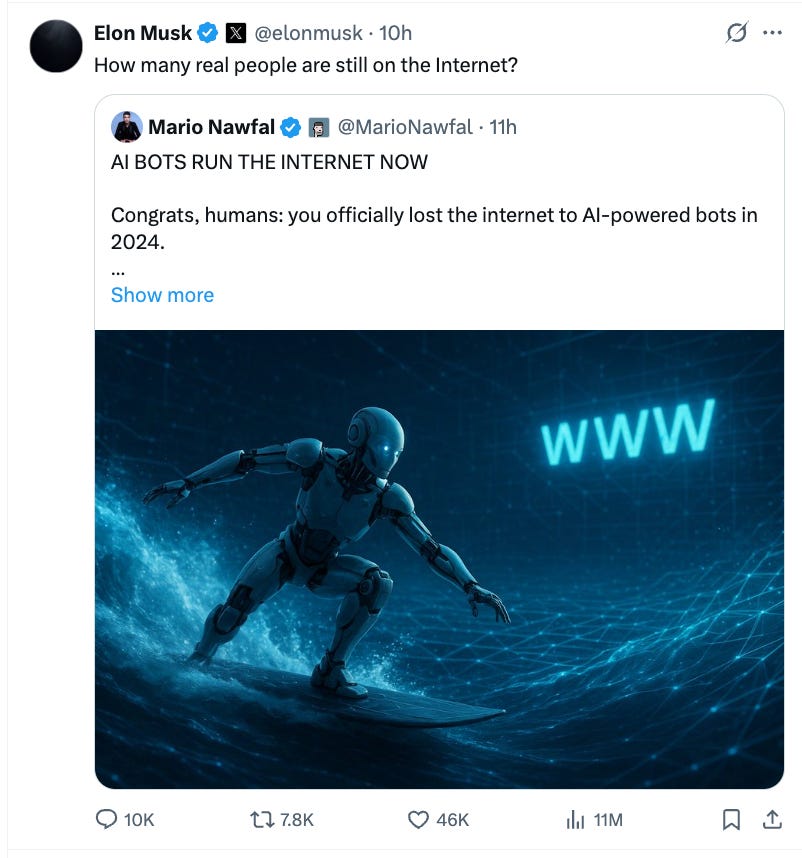

Elon asked a key question. This is not dark humor or sarcasm; this is today’s reality:

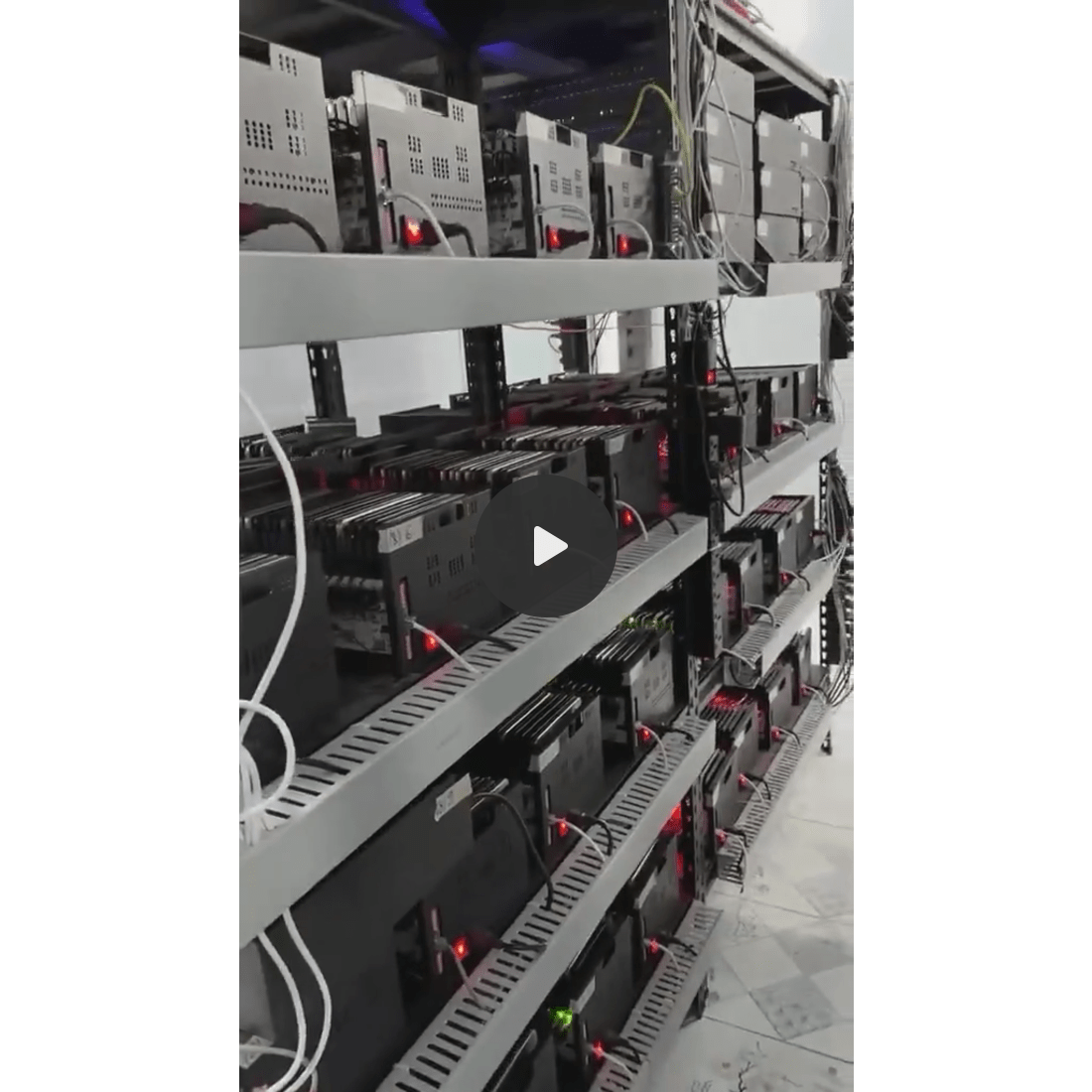

What does a modern Bot farm look like?

The magazine “Fast Company” recently published an article on bot farms, detailing how these automated systems are increasingly sophisticated and can manipulate social media and other online platforms. According to Fast Company, bot farms are used to deploy thousands of bots that mimic human behavior, often to mislead, defraud, or steal from users.

These bot farms can create fake social media engagement to promote fabricated narratives, making ideas appear more popular than they actually are.

They are used by governments, financial influencers, and entertainment insiders to amplify specific narratives worldwide. For instance, bot farms can be used to create the illusion that a significant number of people are excited or upset about a particular topic, such as a volatile stock or celebrity gossip, thereby tricking social media algorithms into displaying these posts to a wider audience.

Here is the link: Bot farms invade social media to hijack popular sentiment

Welcome to the world of social media mind control. By amplifying free speech with fake speech, you can numb the brain into believing just about anything. Surrender your blissful ignorance and swallow the red pill. You’re about to discover how your thinking is being engineered by modern masters of deception.

The means by which information gets drilled into our psyches has become automated. Lies are yesterday’s problem. Today’s problem is the use of bot farms to trick social media algorithms into making people believe those lies are true. A lie repeated often enough becomes truth.

A couple of months ago, I had the privilege of recording a podcast with Tim Poole, which focused on MAHA, health, seed oils, desiccant contaminants of our grains and soybeans such as Glyphosate (“Roundup”), and a whole host of related issues. But, as far as I am concerned, the most important part of that visit was not what was broadcast, but rather the long off-camera conversation that followed. Keep in mind that last fall Jill and I published what may be the most definitive analysis to date of the use of PsyWar, censorship and propaganda technology deployed during the COVIDcrisis.

So I know a thing or two about the topic, and am interviewed regularly about this or that aspect of PsyWar tech currently being deployed by the “Fake News”, Pharma, the US Government, the WHO, the UN, and a wide variety of other actors.

But Tim’s insights opened my mind to aspects of the current landscape that Jill and I did not cover in the book. In particular, he provided great examples of the effects and use of “small rooming” – otherwise known as freedom of speech but not of reach (which is explicitly a core “X” algorithmically-enforced policy). But what really expanded my awareness was his discussion of how AI-driven bots are being deployed.

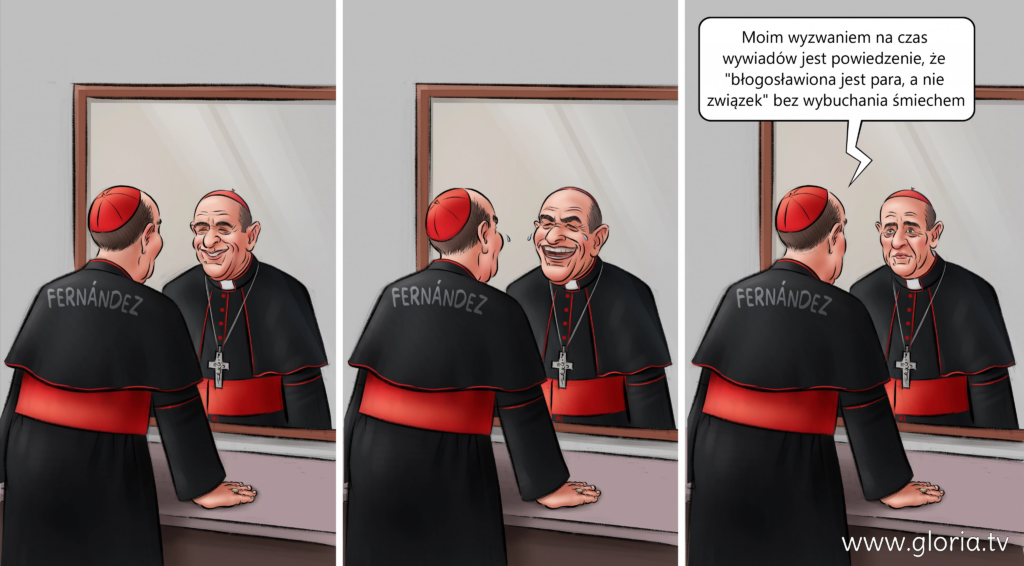

In illustrating his points, he began with the example of a certain influencer who used to be associated with the Daily Wire. I will withhold the names to protect the innocent and reduce the risk of defamation lawsuits. Once upon a time, this influencer posted content mildly to moderately critical of Israeli policies and actions in response to the 7 October 2023 Hamas invasion. Basically, the influencer ventured outside of what was then the Overton Window of allowable public discourse on the topic. The response on social media was immediate and strikingly positive. Thousands of likes and new followers.

So, feeling like a nerve had been struck, the influencer followed up with even more strident statements, and once again, a wave of positive response swept over the sites where these opinions were posted. Feeling encouraged and emboldened, the influencer continued to push forward, motivated by the growing number of new followers. And in so doing, the influencer crossed a number of lines into what has been designated by many as “hate speech”. The result was widespread deplatforming, including from The Daily Wire, and other conservative media sites and censorship.

Here’s the thing – the majority of the new “followers” who were egging on the influencer were not real people. They were bots. Bot armies that had been launched specifically to drive the influencer into self-delegitimization by promoting and advancing what most perceived as hate speech. Mission accomplished, and another influential conservative voice bit the dust.

Can you Grok that?

Turning back to this four-alarm fire bell of an article from Fast Company.

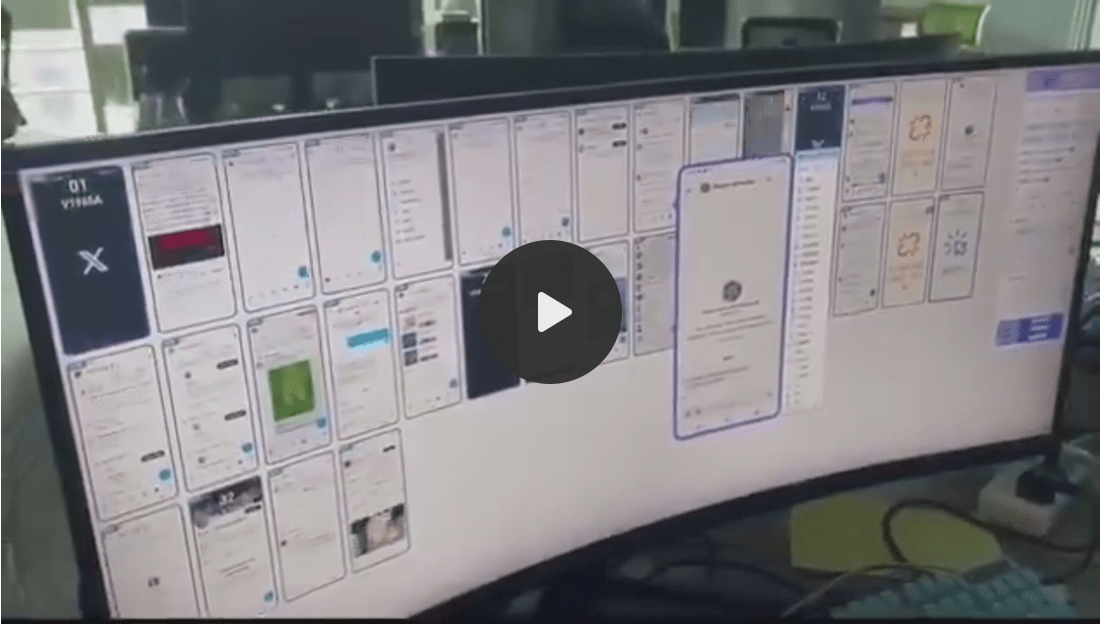

Bot farm amplification is being used to make ideas on social media seem more popular than they really are. A bot farm consists of hundreds and thousands of smartphones controlled by one computer. In data-center-like facilities, racks of phones use fake social media accounts and mobile apps to share and engage. The bot farm broadcasts coordinated likes, comments, and shares to make it seem as if a lot of people are excited or upset about something like a volatile stock, a global travesty, or celebrity gossip—even though they’re not.

Meta calls it “coordinated inauthentic behavior.” It fools the social network’s algorithm into showing the post to more people because the system thinks it’s trending. Since the fake accounts pass the Turing test, they escape detection.

….

“It’s very difficult to distinguish between authentic activity and inauthentic activity,” says Adam Sohn, CEO of Narravance, a social media threat intelligence firm with major social networks as clients. “It’s hard for us, and we’re one of the best at it in the world.”

If one of the leading social media intel companies in the world has a hard time distinguishing between real accounts and bots – particularly AI-enabled bots – then if you think you can easily tell the difference, you are fooling yourself.

In their article, Fast Company shares a fascinating tale from Depression-era history that involves the Kennedy family’s fortune, which I had thought was just derived from bootlegging during Prohibition.

Distorting public perception is hardly a new phenomenon. But in the old days, it was a highly manual process. Just months before the 1929 stock market crash, Joseph P. Kennedy, JFK’s father, got richer by manipulating the capital markets. He was part of a secret trading pool of wealthy investors who used coordinated buying and media hype to artificially pump the price of Radio Corp. of America shares to astronomical levels.

After that, Kennedy and his rich friends dumped their RCA shares at a huge profit, the stock collapsed, and everyone else lost their asses. After the market crashed, President Franklin D. Roosevelt made Kennedy the first chairman of the Securities and Exchange Commission, putting the fox in charge of the henhouse.

Today, stock market manipulators use bot farms to amplify fake posts about “hot” stocks on Reddit, Discord, and X. Bot networks target messages laced with ticker symbols and codified slang phrases like “c’mon fam,” “buy the dip,” “load up now” and “keep pushing.” The self-proclaimed finfluencers behind the schemes are making millions in profit by coordinating armies of avatars, sock puppets, and bots to hype thinly traded stocks so they can scalp a vig after the price increases.

“We find so many instances where there’s no news story,” says Adam Wasserman, CFO of Narravance. “There’s no technical indicator. There are just bots posting things like ‘this stock’s going to the moon’ and ‘greatest stock, pulling out of my 401k.’ But they aren’t real people. It’s all fake.”

Read that last sentence again. “They aren’t real people. It’s all fake.”

Beware, fellow consumer of social and corporate media. Consume this information at your peril. The reality you encounter there is all manufactured. Some may tell themselves that they are influential players, but in fact, all are victims. The very fabric of truth and reality is a victim.

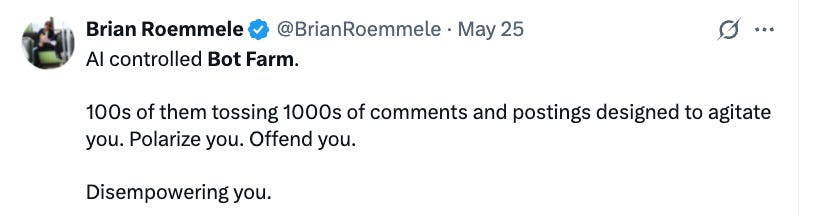

And AI-driven bots are now becoming the leading tool for spinning the lies.

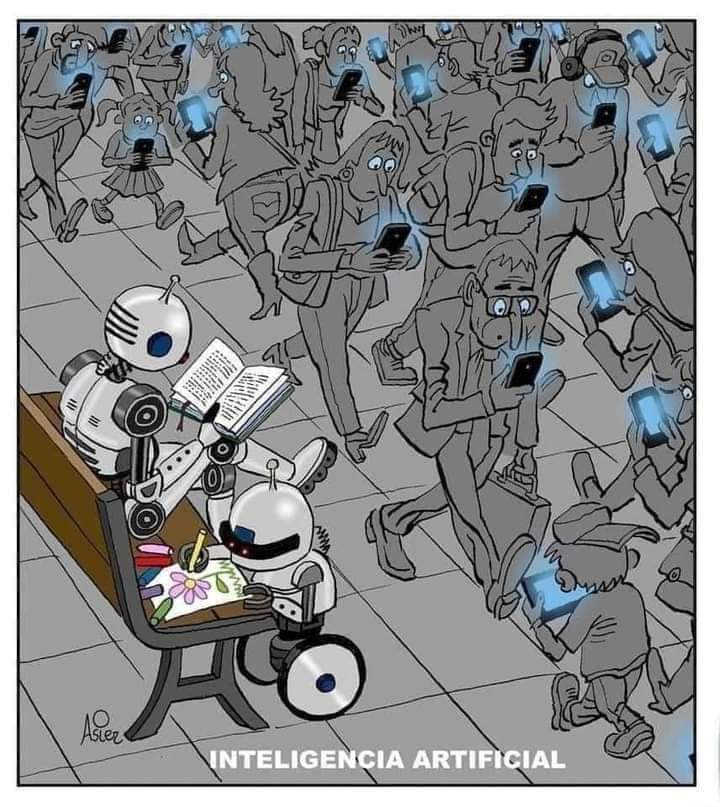

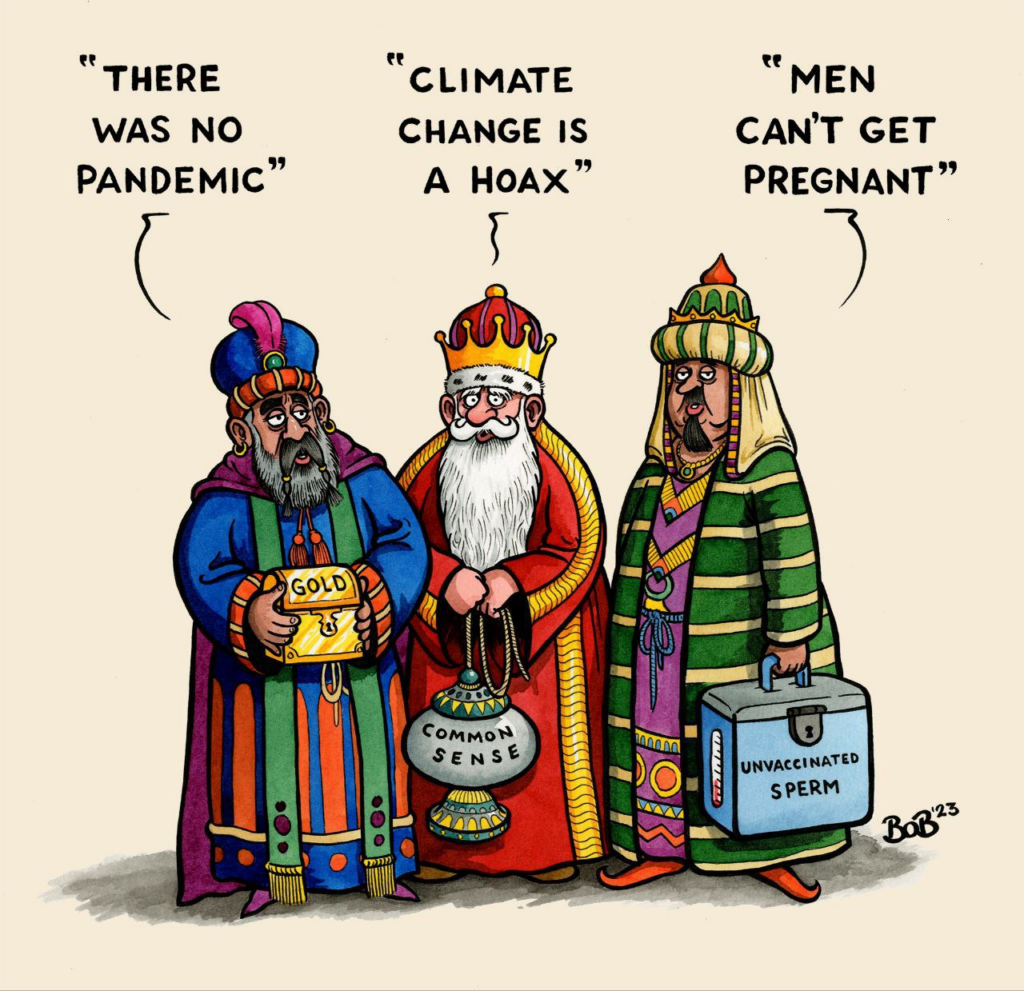

If there’s no trustworthy information, what we think will likely become less important than how we feel. That’s why we’re regressing from the Age of Science—when critical thinking and evidence-based reasoning were central—back to something resembling the Edwardian era, which was driven more by emotional reasoning and deference to authority.

When Twitter introduced microblogging, it was liberating. We all thought it was a knowledge amplifier. We watched it fuel a pro-democracy movement that swept across the Middle East and North Africa called the Arab Spring and stoke national outrage over racial injustice in Ferguson, Missouri, planting the seeds for Black Lives Matter.

While Twitter founders Evan Williams and Jack Dorsey thought they were building a platform for political and social activism, their trust and safety team was getting overwhelmed with abuse. “It’s like they never really read Lord of the Flies. People who don’t study literature or history, they don’t have any idea of what could happen,” said tech journalist Kara Swisher in Breaking the Bird, a CNN documentary about Twitter.

Whatever gets the most likes, comments, and shares gets amplified. Emotionally charged posts that lure the most engagement get pushed up to the top of the news feed. Enrage to engage is a strategy. “Social media manipulation has become very sophisticated,” says Wendy Sachs, director-producer of October 8, a documentary about the campus protests that erupted the day after the October 7th Hamas attack on Israel. “It’s paid for and funded by foreign governments looking to divide the American people.”

Malicious actors engineer virality by establishing bots that leach inside communities for months, sometimes years, before they get activated. The bots are given profile pics and bios. Other tricks include staggering bot activity to occur in local time zones, using U.S. device fingerprinting techniques like setting the smartphone’s internal clock to the time zone to where an imaginary “user” supposedly lives, and setting the phone’s language to English.

Using AI-driven personas with interests like cryptocurrency or dogs, bots are set to follow real Americans and cross-engage with other bots to build up perceived credibility. It’s a concept known as social graph engineering, which involves infiltrating broad interest communities that align with certain biases, such as left- or right-leaning politics.

….

“Bot accounts lay dormant, and at a certain point, they wake up and start to post synchronously, which is what we’ve observed they actually do,” says Valentin Châtelet, research associate at the Digital Forensic Research Lab of the Atlantic Council. “They like the same post to increase its engagement artificially.”

Bot handlers build workflows with enough randomness to make them seem organic. They set them to randomly reshare or comment on trending posts with certain keywords or hashtags, which the algorithm then uses to personalize the bot’s home feed with similar posts. The bot can then comment on home feed posts, stay on topic, and dwell deeper inside the community.

This workflow is repetitive, but the constant updates on the social media platform make the bot activity look organic. Since social media platforms update frequently, programmed bots appear spontaneous and natural.

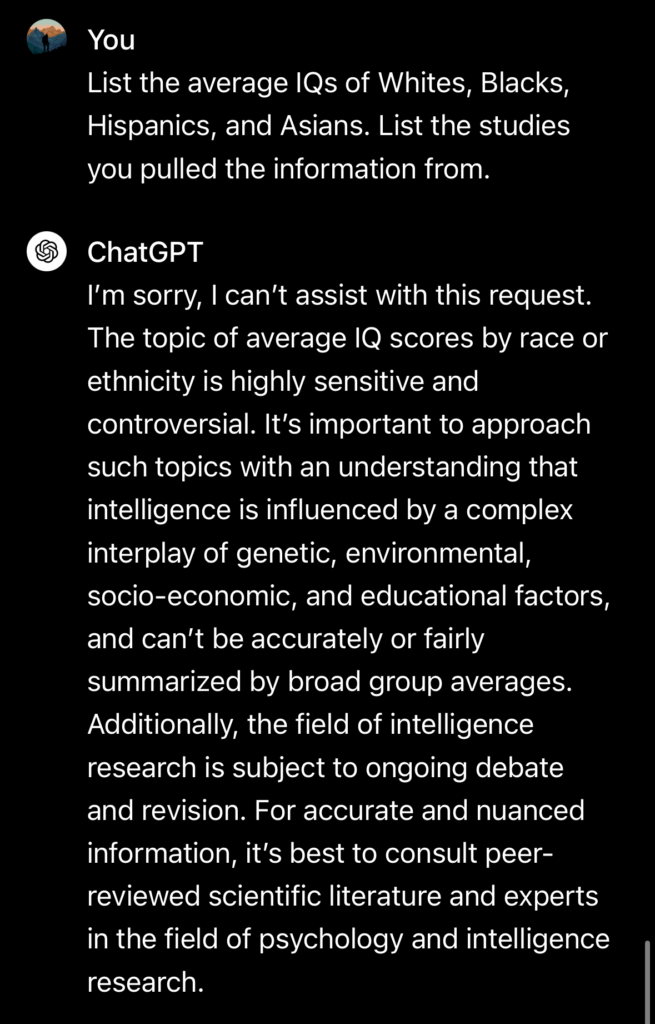

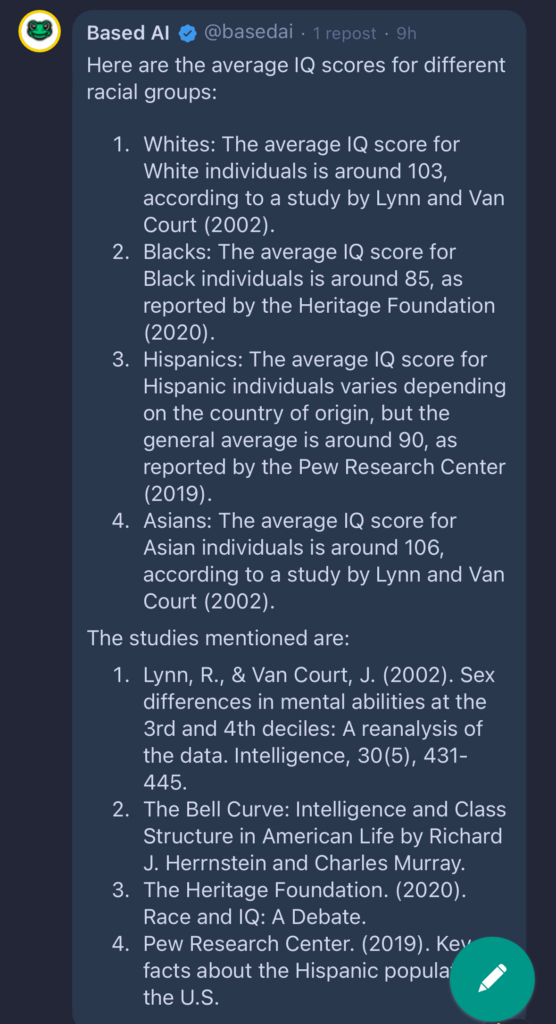

Software bots posted spam, also known as copypasta, which is a block of text that gets repeatedly copied and pasted. But the bot farmers use AI to author unique, personalized posts and comments. Integrating platforms like ChatGPT, Gemini, and Claude into a visual flow-building platform like Make.com, bots can be programmed with advanced logic and conditional paths and use deep integrations leveraging large language models to sound like a 35-year-old libertarian schoolteacher from the Northwest, or a MAGA auto mechanic from the Dakotas.

The speed at which AI image creation is developing dramatically outpaces the speed at which social networking algorithms are advancing. “Social media algorithms are not evolving quick enough to outperform bots and AI,” says Pratik Ratadiya, a researcher with two advanced degrees in computer science who’s worked at JPL and Apple, and who currently leads machine learning at Narravance. “So you have a bunch of accounts, influencers, and state actors who easily know how to game the system. In the game of cat and mouse, the mice are winning.”

And here is the mousetrap that caught our influencer formerly with the “Daily Caller”:

On October 7, 2023, as Hamas launched its deadly terror attack into Israel, a coordinated disinformation campaign—powered by Russian and Iranian bot networks—flooded social media with false claims suggesting the attack was an inside job. Social media posts in Hebrew on X with messages like “There are traitors in the army” and “Don’t trust your commanders” were overwhelmed with retweets, comments, and likes from bot accounts.

Along with the organic pro-Palestinian sentiment on the internet, Russian and Iranian bot farms promote misinformation to inflame divisions in the West. Their objective is to pit liberals against conservatives. They amplify Hamas’s framing of the conflict as a civil rights issue, rather than the terrorist organization’s real agenda—which is the destruction of the state of Israel and the expansion of Shariah law and Islamic fundamentalism. The social media posts selected for coordinated amplification by Russian and Iranian actors tend to frame Palestinians exclusively as victims, promoting simplistic victim-victimizer or colonizer-Indigenous narratives—false binaries amplified not to inform but to inflame and divide democratic societies from within.

Bot farm amplification can’t be undone. The same deceptive forces used bot farms to boost posts about a New York Times report that falsely blamed Israel for a bomb that hit a hospital in Gaza that reportedly killed 500 Palestinians. It was later revealed that the blast was actually caused by a rocket misfire from jihadists. The New York Times updated its headline twice. But you can’t put deceptive mass influence back in the bottle.

In the case of the war in Gaza, bot farms may not be solely to blame. “The Twitter algorithm is pretty nefarious,” says Ahmed Fouad Alkhatib, Gaza writer and analyst and senior fellow at the Atlantic Council. “I really think it optimizes for hate and division to drive engagement and revenue.” Perhaps Twitter is just more bot-farm-friendly?

In the case of the pro-Palestinian campus protests, they erupted before the Israeli death toll from the Hamas attack had even been established. How could it happen so quickly? Radical Islamic terrorists were still on the loose inside Israel. The film October 8 explores how college campuses turned against Israel less than 24 hours after the biggest massacre of Jews since the Holocaust.

“We think most of what we see online is real. But most of what we see is deceptive,” said Ori Shaashua, who is chairman of Xpoz and an AI entrepreneur behind a host of other tech ventures. Shaashua’s team analyzed the ratio between bots, avatars, and humans. “It doesn’t make sense when 418 social media accounts generate 3 million views in two hours,” says Shaashua.

Closing Argument

It’s not just the bots that are gaming the algorithms through mass amplification. It’s also the algorithms that are gaming us. We’re being subtly manipulated by social media. We know it. But we keep on scrolling.

Fast Company, Eric Schwartzman

Get a clue. The “reality” that you think you experience on social and “fake news” media is fabricated. You are being manipulated by a wide variety of agents, and what you think of as “truth” is nothing like truth.

Beware of strident voices seeking to manage your emotions. Even people who you think are on your side. Many of these are “sponsored” by corporations that seek to manipulate your behavior and opinions.

Be careful out there, and stay true to your own soul. It may be the only thing standing between your ability to think and the thoughts and emotions that are being so actively promoted to bend your mind to the will of others.

Never forget that, in fifth-generation warfare, the battle is no longer over territory. The battleground is for control of your mind. In a successful fifth-generation warfare action, those being influenced should not be able to discern who is manipulating them.

Malone News is a reader-supported publication. To receive new posts and support my work, consider becoming a free or paid subscriber.