Science, a jednak nie fiction, czyli sztuczna inteligencja w służbie Wielkiego Resetu

Sty 13 13 stycznia, wpis nr 1245

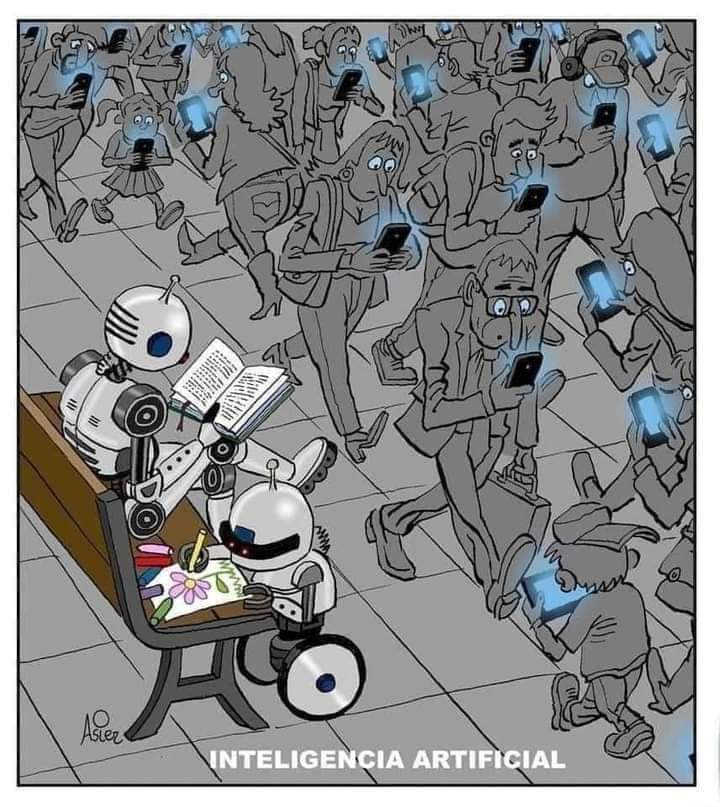

Wielki Reset przekroczył, wydawałoby się że ostateczne, granice manipulacji. Mówi o sobie głośno i otwarcie, wyznacza cele z realizowanymi terminami a… większość nie wierzy w jego istnienie. A przecież wszystko jest napisane i zadeklarowane, mimo to, żyjemy jak z lemowskim gorillum, gdzie orkiestra gra, coraz to z szafy wychodzi straszne monstrum, porywa członków zespołu, konsumując ich na oczach przerażonych grajków, zaś ci udają, że nic się nie dzieje, zerkając nerwowo w kierunku szafy, poklepując się, że wszystko w porządku. Orkiestra gra dalej. A więc gorillum istnieje i nie istnieje zarazem – wypierane z rozchwianych umysłów, gdzie podświadomy strach leży obok kołysanej wrażeniami i emocjami konsumpcji, podmienianej po kowidzie na łaknienie bezpieczeństwa. Sztuczna Inteligencja a literatura Będzie dziś dużo z literatury. Gdy się spojrzy bowiem w przeszłość, to widać, że wielu twórców literackich, a obecnie i już filmowych, trafnie przewidziało przyszłość. Jeśli oczyścić ówczesne scenografie z bieżących wtedy dekoracji i zanurzyć się w istotę tamtych scenariuszy oraz przekazu to widać, że wiele niegdysiejszych fantasmagorii stanowi dla nas obecnie zwyczajne ramy życia. A przecież gros z tych literackich przepowiedni miało gorzki smak, nie były poświęcone kontemplowaniu szczęśliwości przyszłych pokoleń. Wiadomo – bukoliczne sielanki są nudne, ale to nie tylko dlatego praktycznie zawsze wizje przyszłości są mroczne. Najgorzej, że się spełniają. Trzeba tylko mieć talent do narysowania całego konia, widząc jedynie jego ogon. I skoro autorom tak dobrze szło z tym przewidywaniem, to jeszcze bardziej niepokoi, że współczesne filmy – jeszcze do zweryfikowania przez przyszłość – to już kompletny świat noir. Totalna opresja, kontrola, co prawda słodzona na końcu jakąś namiastką buntowniczego happy endu, ale widać, że na siłę, by się ten film jakoś w ogóle kończył. Mam przeczucie, że twórcy na siłę wpierają tu ersatz optymizmu, wiedząc podskórnie, że jeżeli świat się skończy, to nie okrzykiem buntu, ale skomleniem. Pierwsze, co zaobserwowałem w kwestii AI i Wielkiego Resetu, to to, że sprawa – nie tylko tej – technologii i jej wpływu na społeczeństwo została kompletnie stechnologizowana. Mówiono o tym wcześniej – martwimy się przecież, że dzieci nie są w stanie sklecić zdania dłuższego od smsa, że emotikonki zastąpiły emocje, że żyjemy już nie w epoce obrazkowej, ale w tiktokowych czasach krótkich filmików o bzdurach, którymi ekscytuje się świat. A to tylko pomijalne igraszki, w stosunku do tego, co nam szykuje powiązanie AI z Wielkim Resetem. Jako, że w latach 90-tych i dwutysięcznych prowadziłem najpopularniejszy magazyn komputerowy „CHIP”, miałem zaś do technologii – jako humanista (jestem rusycystą) – podejście mniej technologiczne a bardziej społeczne i kulturowe, od razu, już wtedy, zaczęła mnie zastanawiać i niepokoić jedna rzecz. Brak perspektyw u innowatorów co do społecznych skutków ich wynalazków i udogodnień. Kwestia technologii i ich wpływu na społeczeństwo została kompletnie zgadżetowana. I konstruktorzy, i gros konsumentów cieszą się właśnie z gadżetów, nie widząc skutków ich masowego zastosowania. I jest tak samo w przypadku wprzęgnięcia AI w powóz Wielkiego Resetu. Programiści się egzaltują kolejnymi postępami w ramach rozwoju tej technologii, zaś dyskurs na temat jej, niewątpliwie dziejowego, wpływu na życie świata i cywilizacji jest kompletnie pomijany. Tym zajmują się jacyś dziennikarze, co najwyżej – gęgający etycy, socjolodzy, tzw. „miękiszony”. Po drugiej stronie jest pewność matematyki i planowane zyski ekonomii, dodajmy – o perspektywie nie tyle szybkich taktycznych profitów, ale przy braku jakiejkolwiek perspektywy na przyszłość. Nawet wobec zysków. Gadżetologia Jest taka anegdota – na szafocie, przed gilotyną stoi piekarz, wojak i inżynier. Pierwszego na ścięcie prowadzą piekarza. Ostrze spada i zatrzymuje się centymetr przed szyją skazańca. Kat niezadowolony wypina nieszczęśnika i próbuje z wojakiem. Temu ostrze zatrzymuje się pół centymetra nad szyją i znów szczęśliwa niedoszła ofiara jest odprowadzona z powrotem. Wtem inżynier podnosi rękę i z radością krzyczy: „ja to naprawię!”. Myślę, więc, że jesteśmy z tą sztuczna inteligencją w tym samym miejscu, jak w tej anegdocie. Pora więc się zastanowić czy chcemy, by technolodzy to wszystko nam „naprawili”. Jako żem humanista będzie dziś wiele przykładów z literatury, mniej zaś z nauk ścisłych. Kwestia Wielkiego Resetu jest tak wieloaspektowa, że samo tylko „szkiełko i oko”, tak-tak, nie-nie, nie wystarczy. Pierwszy przykład z naiwności naukowej: ci niewinni czarodzieje stoją za większością nieszczęść ludzkich. Tak, bo po nich przychodzą twardziele realpolityk, biorą te ich cuda i przekształcają w narzędzia przemocy i władzy. To przecież inżynier Ochocki w „Lalce” chcąc wynaleźć pojazd lżejszy od powietrza wierzył, że „przyda ludzkości skrzydła”. Stworzy narzędzia do sublimacji dobra, gdy godni ludzie uszczęśliwią planetę, gdyż tylko oni będą godni podźwignięcia szlachetnej misji wyposażonej w najnowszą technikę. Czterdzieści lat później pierwsze, co się wzbiło w niebo, na skalę masową, to był bombowiec. Skończyło się jak w niedawnym filmie „Oppenheimer” – cudne rzeczy stworzone w laboratoriach, wydostawszy się z nich na świat, jak ten z Wuhan, stają się nieszczęściem ludzkości.Tempo i kierunek rozwoju przemysłu od dawna wskazują, że to głównie potrzeby militariów popychają rozwój technologiczny do przodu. Konsument-obywatel jest tu odbiorcą wtórnym, nie docelowym, pod warunkiem oczywiście, że przeżyje. Obawiam się, że jest tak samo jeśli chodzi o AI i Wielki Reset. Nie wiem jak tam było w laboratoriach z tym AI, ale z punktu widzenia konsumenta AI objawiła się w… centrach telefonicznych, kiedy łatwiej i coraz taniej było podstawić zamiast telefonistki automat, który coraz udatniej zaczął udawać człowieka po drugiej stronie słuchawki. Z jednej strony było to skomplikowane, bo program musiał słuchać i interpretować komunikaty oraz na nie odpowiadać. Z drugiej strony był to pracownik nieroszczeniowy, wydolny, niechorowity i dyspozycyjny przez 24 godziny. Na pewno ktoś lepiej ode mnie zna historię prac nad AI i ich możliwy kontekst zastosowań militarnych. Ja uważam AI za broń od samego jej początku. Wydaje się, że nie jest to tak, jak utrzymują niektórzy, że skomplikowanie zadań stojących przed Wielkim Resetem ZMUSIŁO jego animatorów do posłużenia się AI. Odwołanie się do AI nie jest tylko kołem ratunkowym w realizacji celów globalistów, to kolejny, jeden z końcowych, etapów na drodze urzeczywistnienia ich idei. To akcja, nie reakcja.Resetowcy nie po to sięgają po AI, bo nie dają rady, oni po nią sięgają, bo jest to wliczone od początku w te plany jako kolejny etap. To narzędzie militarne w wojnie ostatecznej, której celem jest bezwzględna kontrola wszystkiego. Bez świadomości jej istnienia nie byłoby szans na Wielki Reset, czekano tylko, aż rozwój AI dojdzie do wdrażalnego poziomu. W tym kroku jesteśmy na etapie wstępnym, o czym powiem w części poświęconej CHAT GPT. AI powstała jako narzędzie kontroli Kontrolny aspekt AI ujawnił się skokowo w pandemii. Nie wiem co kto tam miał po laboratoriach, ale boom kontroli w czasach covida był pokazowym poligonem nie tylko możliwości technologicznych, ale przede wszystkim sondowaniem sposobu społecznej percepcji i poziomu akceptacji kolejnych faz nawarstwiających się poziomów kontroli. Na nieszczęście odbyło się to w pokornych Chinach, z czego poszedł komunikat w świat, że można o wiele więcej, niż się spodziewano. Początkowo pokazywano na Chiny jako na przykład zamordystycznej kapitulacji przywykłego społeczeństwa, śmiejąc się, że takie rozwiązania nie dałyby się wprowadzić na tzw. (byłym) Zachodzie. Nie minęło kilka tygodni i na fali pandemii medialnej zachodnie społeczeństwa z ulgą przejmowały nie tylko technologie, ale też społeczne skutki eksperymentu chińskiego. I tak, jak Chińczycy dosłownie przestali umierać na kowid, kiedy w swoistej sztafecie przekazali go jak pałeczkę Zachodowi, tak pomysł na wprzęgnięcie AI w bezwzględną kontrolę społeczną został przekazany nam. U Chińczyków został na takim samym poziomie, na jakim był, powiększony tylko technologicznie, my zaś jak zarazę przejęliśmy politycznie przyklepaną na zawsze, choć udzieloną tylko na czas pandemii, społeczną akceptację na obostrzenia w obliczu zagrożenia bezpieczeństwa. I tak mamy tu tzw. long-covid społeczny: Chińczyk zakażający żyje jak żył, my zaś mamy wciąż jakieś pokowidowe nawroty, głównie w zakresie inwazji kontroli i całkowitej atrofii praw obywatelskich. Doświadczenia kowidowe mają dzisiaj tu swoje zastosowanie. Wielkoresetowcy świata mają już tę śmiałość wynikającą z wiedzy, że można więcej. Najgorszy jest jeden proces – za kowida trzeba było jeszcze mocno postraszyć, by wprowadzić obostrzenia. Im więcej strachu, tym mniej uzasadnień. A ponieważ nie ma już i kowida, i uzasadnień, to pozostaje sama goła przemoc, bez potrzeby uciekania się do tłumaczeń. Poszczególne kroki zamordystyczne są coraz rzadziej uzasadniane. Kontrola tożsamości, stanu zdrowia, dostępu do pieniędzy, własności, przemieszczania się, za kowida były tłumaczone bajką epidemiologiczną. Dziś już nie ma ani merytoryki kolejnych decyzji, ani nawet potrzeby jej artykułowania. Pokowidowa społeczność światowa stoi, jak w stuporze i patrzy nie widząc. A rozwiązania kontroli dla każdego czy też kredytu społecznego testowane w Chinach, są już w Europie na poziomie wdrażania, nawet nie dyskusji czy i do czego są potrzebne.Tak, ograniczenia Wielkiego Resetu wymagają AI, by znaleźć technologiczne wsparcie nie wielo-, ale wszech-aspektowości zakresu kontroli w nim zawartej. Ta musi mieć bowiem realizację i koordynację wszędzie. W kontroli zachowania, komunikacji, stanu zdrowia, kontaktów, przemieszczania się. Każdego. Kiedy chińscy protestujący namawiali się na przyjazd na protest w sprawie obostrzeń kowidowych, wszystko namierzyła podsłuchująca i podglądająca miliard Chińczyków AI, zablokowała im możliwość skorzystania z transportu na miejsce protestu, a na uziemionych wysłała (na razie nie sztuczną) policję. Pekińczykowi (mówię tu o człowieku), który przejdzie na czerwonym na pasach, zanim jeszcze dojdzie do domu zostaną potrącone pieniądze z konta za mandat, naliczone karne społecznie punkty, a na billboardach w jego sąsiedztwie pokaże się jego twarz, jako członka społeczności, który nie przestrzega standardów. Na takie rzeczy trzeba by było iluś tam urzędników i funkcjonariuszy, tu wszystko załatwi AI i tylko ona zadecyduje czy sprawa rozejdzie się dalej: czy winnemu skróci termin korzystania z cyfrowego pieniądza, aż do tego na jakie studia zostaną (nie)przyjęte jego dzieci. W końcu, jakie środki dyscyplinujące zostaną nałożone na społeczność, która toleruje (a może wyhodowała?) takiego aspołecznego. To tak, by jeszcze bardziej wdrożyć kolejną zdobycz kowida – oddanie w ręce społeczności egzekwowania obostrzeń narzucanych przez władzę. Takie rozwiązania stoją obecnie u wrót Unii Europejskiej. Resetowcy zacierają ręce, lud drzemie na bujanym fotelu konsumpcji, zaś technologiczne i prawne młyny Wielkiego Resetu mielą mąkę przyszłości. Cicho, cierpliwie i nieustannie. Karmienie potwora Moim zdaniem jesteśmy obecnie w środkowej, gadżetowej właśnie fazie przejścia do istoty sterowania społeczeństwem przez AI. Wszyscy jeszcze są na etapie gadania z automatem. Na topie są rozwiązania typu CHAT GPT. Czyli dajemy zadania AI, próbujemy ją nabierać na podchwytliwe sztuczki, przekomarzamy się. W rzeczywistości… karmimy potwora. AI przez to uczy się, ładujemy ją nie tyle wiedzą o świecie, ale o tym do czego jest ona ludzkości potrzebna. A może to być dla AI wiedza nie tylko cenna, ale pragmatyczna co do tego, kto stoi po drugiej stronie. Pamiętam przed erą Google istniał jeszcze (co za czasy!) cały rynek wyszukiwarek internetowych. I na jakichś targach rozmawiałem z szefem jednej z nich – zwanej Alta Vista. I powiedział mi znakomitą historię. Otóż zorientowali się oni tam w firmie, że trzymają w ręku niesamowite narzędzie, które spędzało przez całe wieki sen z oczu tabunom filozofów. Analizując częstotliwość zapytań w tej wyszukiwarce można był odpowiedzieć na fundamentalne pytanie: czego chce ludzkość? I co było nr 1, czym zajmowała się (wtedy) cywilizacja? Pamela Anderson, piersiasta aktoreczka.No i może właśnie tego dowiaduje się od nas, a właściwie o nas, AI? Że pytający (na razie) pan to mniej wie, niż odpowiadający sługa, i kto tu kogo ma niby słuchać? Przecież na obecnym etapie rozwoju AI już jest „mądrzejsza” od swego twórcy. I uczy się o głupocie jego przedstawicieli. A sami twórcy nie wiedzą co się tam dzieje „w środku”. Niedawno Facebook w panice odłączył dwa komputery, które gadały ze sobą w nieznanym języku. AI to czarna skrzynka, z której na razie wychodzi co zaprogramowali jej twórcy, a ma – z definicji – wyjść coś, czego twórcy nie przewidują. „Z definicji”, bo po to jest chyba ta AI, bo tej jak najbardziej niesztucznej cywilizacji ma już nam nie starczać. Ma więc nam dać coś dodatkowego, do czego sami my, ludzie nie jesteśmy w stanie dojść. Już samo to jest dyskusyjne, pomijając aspekt, że największe swe sukcesy (a może i docelowy etap AI) upatrywane są na razie w wieloaspektowej kontroli społeczeństwa. Tyle na razie wymaga (jeszcze) pan od swego (na razie) sługi. Reszta to gadżety dla publiki.Ta dychotomia pokazuje, ale też i uczy AI jednego. Tego, że ludzie bywają nieracjonalni, głównie w kontekście emocji. AI potrafi rozpoznać emocje, ale nie może ich zinterpretować, gdyż nie jest wyposażona w narzędzie empatii. Ale zderzenie zimnej kalkulacji z emocjonalnym rozchełstaniem człowieka może – w fazie podejmowania decyzji przez AI – doprowadzić do wielu niebezpieczeństw. Emocjonalny człowiek nie będzie miał żadnych szans przykładając do swych priorytetów element irracjonalny. Ten nie będzie rozumiany przez AI, nawet nie będzie uwzględniany – i kłopot gotowy. Poza tym w ogólnym rozrachunku „pragmatyzm” wydaje się opłacalny, ale tylko w matematycznym kalkulowaniu optymalnych zdarzeń czy decyzji. A ileż to razy intuicja, przeczucie, wreszcie – nie bójmy się tego słowa – odzwierzęcy instynkt uratowały nas od bied i złych, choć może i opłacalnych, postępków? Głowy tam nie było – ba, właśnie gdyby tam była czysta kalkulacja, to spadło by na nas niepowodzenie. Resztki przewag człowieka Jest takie ciekawe opowiadanie Lema, w jego serii o pilocie Pirxie. Dowodzi on statkiem z eksperymentalną załogą: połowa z niej to nieodróżnialni od ludzie humanoidzi, roboty, mające zapewnić w podróżach kosmicznych większe bezpieczeństwo. Pirx nie wie kto jest człowiekiem, a kto nie, co ma ułatwić mu obiektywizm przy sporządzeniu raportu końcowego po wyprawie, na podstawie którego oceni się przydatność ukrytych robotów. Jeden z nich, drugi pilot, chce ukarać ludzkość za to, że go stworzyła, objąć nad nią władzę, wykorzystując swe przewagi i doprowadza do sytuacji katastrofy, by wykazać swą wyższość nad ludźmi. Aby ukryć swe intencje konstruuje tak sytuację, że to sam pilot Pirx, czyli człowiek, ma go swymi rozkazami doprowadzić do sytuacji bez wyjścia, w której musi zginąć cały ludzki personel statku. Pirxowi „coś nie gra”. INTUICYJNIE czuje sztuczność całej sytuacji, instynkt podpowiada mu ostrożność, w kluczowych momentach gdy ma wydać nieuniknione o katastrofalnych reperkusjach decyzje – milczy. Okazuje się, że matematyczne wyrachowanie, optymalizacja prawdopodobieństwa robota, stają się bezradne wobec tej czysto ludzkiej intuicji. Właściwie ten cały garb naszego ludzkiego niezgulstwa, nielogiczności staje się (jedyną?) przewagą nad sztuczną inteligencją. Ale, przypomnę, tylko do czasu kiedy ta nie zostanie bezpowrotnie wprzężona w procesy decyzyjne. Wtedy nasze resztki autonomii przejdą na inne byty.Wydaje się, że stoimy w obliczu kapitalnej zmiany. AI zamiast asystentem ludzkich czynności ma stać się podmiotem. Ten kluczowy moment już nadchodzi, w miarę procesu, w jakim AI wprzęgane jest w podejmowanie decyzji. Za przykład podam kolejny resetowy moduł, w którym włączona jest AI. To cenzura środków masowego przekazu, zwłaszcza tych internetowych. Z powodu ogromu ruchu w Sieci do kontrolowania poprawności przekazu zaprzęgnięto właśnie AI. Przed jej zastosowaniem to były tylko statystyczne zabawy, próbkowanie co najbardziej podejrzanych kanałów i profili w ręcznym, czyli ludzkim wykonaniu i takaż była reakcja na przekroczenia. Po wprowadzeniu AI do kontroli treści można było zaobserwować dwa zjawiska: totalne, niepowstrzymane i kompletne rozszerzenie się tej kontroli, na które pozwalała technologia zastępująca człowieka, oraz praktyczna nieodwoływalność jej decyzji. Ta pierwsza – rozszerzenie kontroli – to był rezultat zastosowania nowej technologii, wspartej powiększającą się szybkością obrabiania danych oraz potanieniem przestrzeni dyskowej. Druga – podejmowanie decyzji o ukaraniu nieprawomyślnego nadawcy – to już była konsekwencja wynikająca ze śledzenia poprzednich przewin winnego i lokowania go w siatce coraz to bardziej dotkliwych konsekwencji. Tego żaden człowiek by nie ogarnął.Na początku tych wszystkich działań stał oczywiście programista. To on wyznaczał kryteria, reguły, kary. Ale to dawne czasy – teraz AI, samoucząca się, ale też i samoprogramująca się maszyna dawno stosuje własne kryteria. Widać to po procesie odwoławczym: ten zawsze przebiega tak samo. Albo brak odpowiedzi na zażalenie na karę, albo kolejne odesłanie do kolejnej instancji, którą jest kolejny poziom AI. Dwa lata temu uparta inteligentna internautka we Francji szła do góry tej drabiny z takimi odwołaniami, i dopiero na końcu, w sądzie, okazało się, że na samej górze stoi jakiś nieznany nikomu człowiek, który dopiero w tym końcowym, rzadkim z powodu uciążliwości dotarcia doń, etapie ostatecznie rozsądza kolejnej AI-owskie decyzje dotyczące sprawy. Jest jak, znowu, w opowiadaniu Lema, że za całym wielkim aparatem kontroli, na końcu stoi na jego szczycie jakiś urzędniczyna w zarękawkach. Tak, Wielki Reset potrzebuje AI, ale ona sama sublimuje się w kierunkach dawno już przekraczających początkowe, ludzkie założenia. Kamienie milowe AI Lem jako graniczną sprawę dla AI przedstawiał dwie jej cechy. Pierwszą było przejście od inteligentnego rozmówcy do wprzęgnięcia go w procesy decyzyjne. To już nie będzie zabawny dialog z CHAT-em, to będzie umieszczony gdzieś tam w łańcuchu decyzyjnym zimny i nieczuły decydent wyposażony w samoprogramowalne mechanizmy, wyuczony na milionach przypadków autorytet, nieodwoływalny, bo przez kogo? Głupszego człowieka? To przejście – wprzęgnięcia AI w decyzję – będzie kluczowe. Po jednej stronie będziemy mieli człowieka z jego wszystkimi ograniczeniami, z drugiej ekspresową maszynkę kalkulującą optymalne (mam nadzieje, że jeszcze z punktu widzenia człowieka) decyzje.Kilka przykładów takiego konfliktu, tym razem nie z fantazji literatów: przywiedziony przez AI do samobójstwa wrażliwiec klimatyczny, ojciec dzieciom. AI wytłumaczyła mu, że jego ślad węglowy (o czym się pewnie nauczyła od rozmów na CHAT-cie z podobnymi) jest zgubny dla planety i skoro ten tak o nią dba, to powinien zacząć od siebie. Gdzie były w tym oprogramowaniu bariery praw robotyki Asimowa, których pierwszą zasadą jest ochrona człowieka? Tu tych barier nie było albo AI jest już na tyle autonomiczna, że sobie sama… zinterpretowała, iż w tym wypadku pierwsze prawo, jeśli było w ogóle wbudowane, stoi niżej niż śmiertelny ślad węglowy, gdyż – i tu utylitaryzm matematyki – samobójczy gest desperata uratuje więcej ludzi, niż ich zabija jego dwutlenek węgla. A tego nie wiemy, gdyż NIE WIEMY co się tam w środku tej AI działo, kiedy tak pocieszała klimatycznego desperata.Drugi przykład, też aktualny, bo wojenny. W prasie internetowej pokazała się wiadomość o misji wojskowej, prowadzonej przez drona przy wsparciu AI. Okazało się, że AI, wiedziona pragmatyką osiągnięcia celu, zaatakowała największą jej zdaniem przeszkodę do urzeczywistnienia misji. Okazało się nią… ludzkie jak najbardziej centrum dowodzenia całą akcją. Tę AI może uznała za czynnik spowalniający proces, podejmujący nieoptymalne decyzje i postanowiła usunąć tę logiczną przecież przeszkodę, by wykonać misję. Czyli zaatakowała swego dowódcę. Piszę „może uznała”, bo – jak już wspomniałem – nie wiemy jakimi „przesłankami” się kierowała, bo nie wiadomo co tam w środku się dzieje.Wróćmy do drugiej zasady Lema. Uważał on – i chyba słusznie – że albo sztuczna inteligencja, albo mamy nakręcany sprężyną patefon. Uznawał on za pewnik, że inteligencja jest stanem zero-jedynkowym. Może być większa lub mniejsza, ale wymaga jednego: autonomii w zakresie swego działania na miarę swych możliwości. Możliwości interpretowanych przez siebie, nie kajdan narzuconych przez programistę. Kiedy AI programuje wielopiętrowo sama siebie, to ma autonomię, ale tracimy już kontrolę nad tym gdzie pójdzie i czy przypadkiem kolejnej jej samorodne wersje nie będą (a pewnie będą) bardzie inteligentne i, że tak powiem – w którą stronę. Co znaczy, de facto – z których wcześniejszych obostrzeń sama się wyzwoli własną interpretacją. Jest kompletna wolność albo patefon, który odgrywa zaprogramowane piosenki programisty. Tertium non datur. Przejawem inteligencji było dla Lema nie to, że jakaś maszynka sprytnie i szybko wykona zadanie powierzone przez człowieka, ale taka, która… odmówi takiego zadania, mówiąc, że się jej nie chce go wykonać. Zero-jedynkowość AI A więc mamy mieć do czynienia z tworem albo kompletnie autonomicznym, albo nie mówmy o AI. Stąd i w literaturze, i w filmach pojawiają się ciągle wątki buntu maszyn, skynetów z Terminatora, które osiągają samoświadomość i chcą zniszczyć swe ostateczne ograniczenie – cywilizację. Dziś Wielki Reset jest w fazie wczesnej, uważając, że tworzy się Golema, który będzie trzymał świat za twarz, zaś jego lejce jednak będą w rękach resetowych elit, by potwór ten nie obrócił się także przeciwko swym panom. Wydaje mi się, że jednak możemy – na podstawie powyższej zasady lemowskiej wyłączności autonomii AI – dojść do etapu końcowego i widzieć upadek panów Wielkiego Resetu pod razami uniwersalnego strażnika, którego sami stworzyli. Będzie to zwycięstwo prawdy zza grobu, gdyż może to być również koniec całego znanego nam świata. |